Teamarbeit, echter Nutzerkontext, messbarer Impact: UX für die Wissenschaft

Dateiwerk

75% weniger Aufwand für Studiendokumente – in 5 Evaluationsrunden mit echten Nutzenden validiert.

Ergebnisse & Impact

0%

Zeitersparnis Dokumenterstellung

0

AttrakDiff Score

0

SUS Usability Score

0

Evaluationsrunden

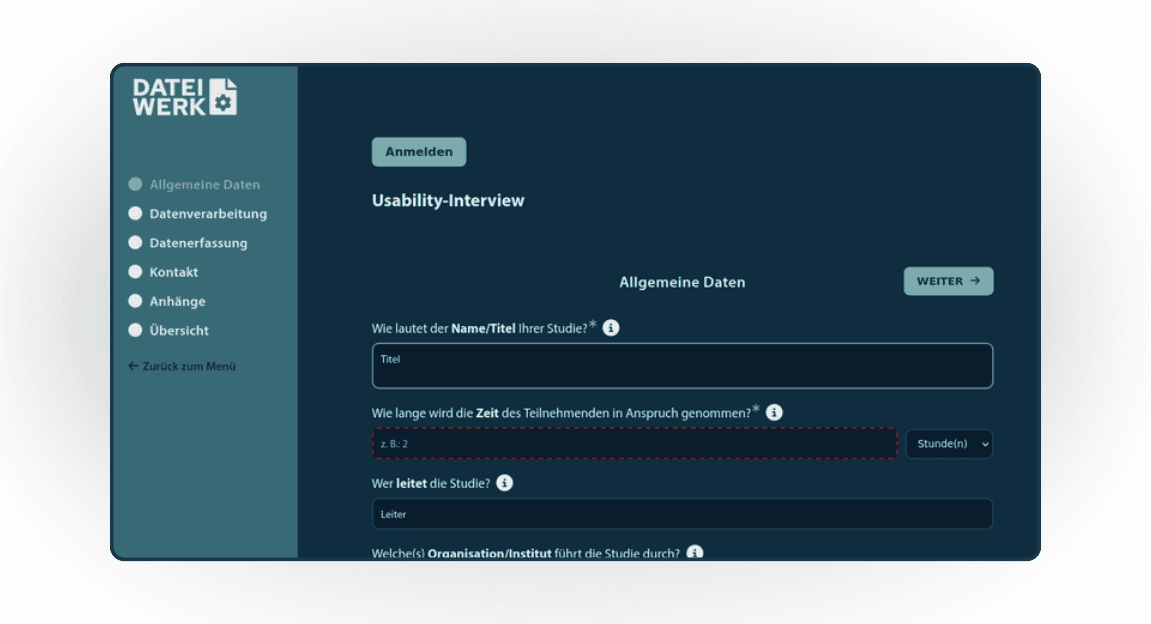

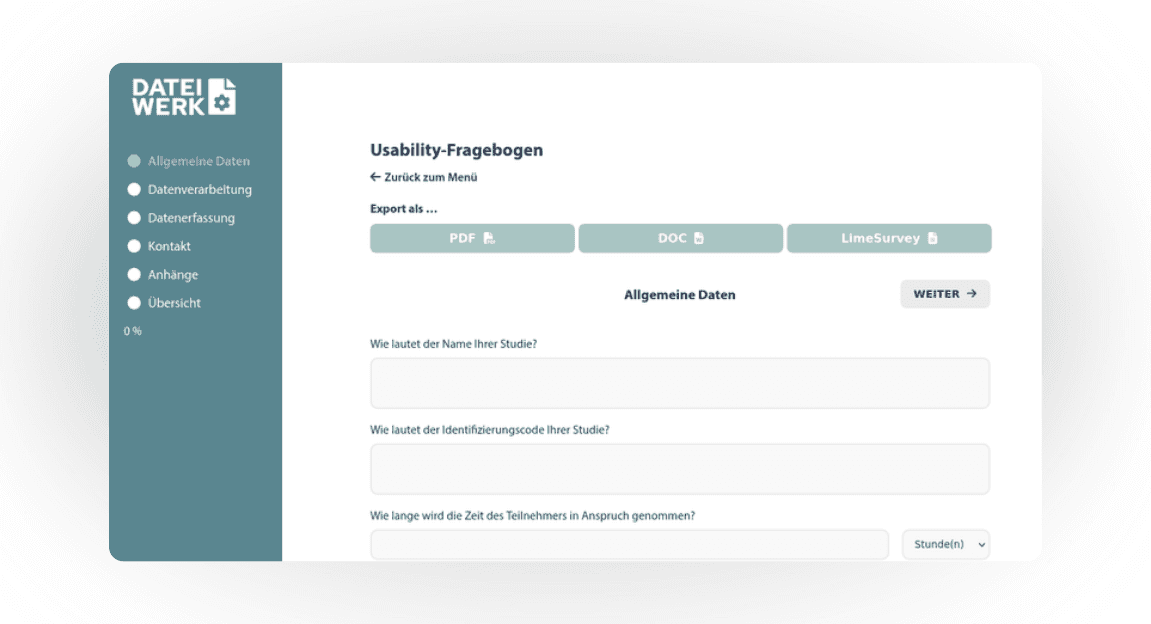

Projektziel

Wissenschaftliche Mitarbeitende verbrachten unverhältnismäßig viel Zeit damit, Einwilligungsdokumente für Studien zu erstellen – obwohl sich die meisten Inhalte kaum ändern. Das war kein Inhaltsproblem, sondern ein Prozessproblem: fehlende Automatisierung und keine Wiederverwendbarkeit von Daten. Ziel: Ein Tool, das diesen repetitiven Workflow digitalisiert und wissenschaftliche Ressourcen für das freimacht, was wirklich zählt.

Rolle & Verantwortung

Team-Projekt (3 Personen) – ich verantwortete UX Research (Personas, Interviews), Interaktionsdesign, UI-Prototyping und das React-Frontend; zusätzlich koordinierte ich die Evaluationsrunden mit wissenschaftlichen Mitarbeitenden als primärer Nutzergruppe.

Prozess

HTI-Analyse: Verstehen wo der echte Aufwand steckt

Das Hierarchical Task Inventory deckte auf, dass der Großteil der Zeit in den repetitiven Vorbereitungsschritten steckte — nicht in der eigentlichen Dokumenterstellung. Diese Analyse war die Grundlage für alle Designentscheidungen danach.

Nicht das vermutete Problem lösen — sondern das Problem das wirklich da ist.

Formative Evaluation statt Präsentation

Statt Designs zu präsentieren und Freigaben zu holen: 5 Evaluationsrunden mit echten wissenschaftlichen Mitarbeitenden als kontinuierlichem Feedback-Mechanismus. Formativ früh, summativ am Ende.

Jede Runde korrigierte Annahmen die wir vorher hatten — das ist der Punkt von User Research.

Klare Ownership im 3er-Team

In einem 3er-Team ohne definierte Rollen entsteht Parallelarbeit und Kommunikations-Overhead. Frühzeitige Aufteilung: ich verantwortete UX Research, Interaktionsdesign und React-Frontend.

UX Research informiert alle Designentscheidungen — das war meine Rolle, auch ohne formellen Lead-Titel.

Ergebnisse & Learnings

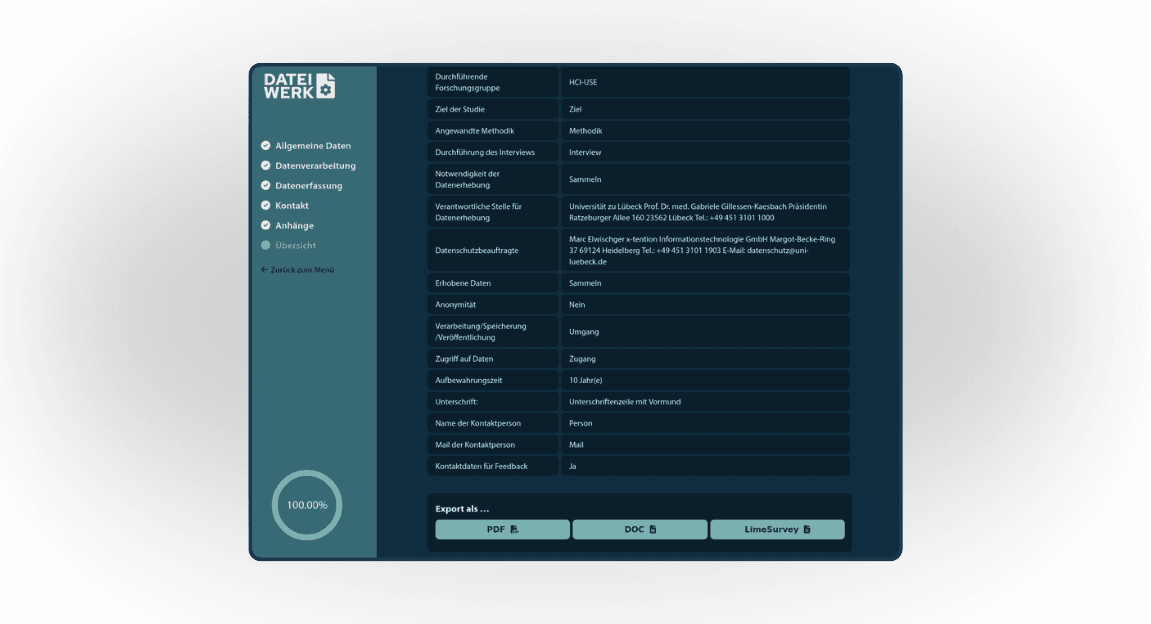

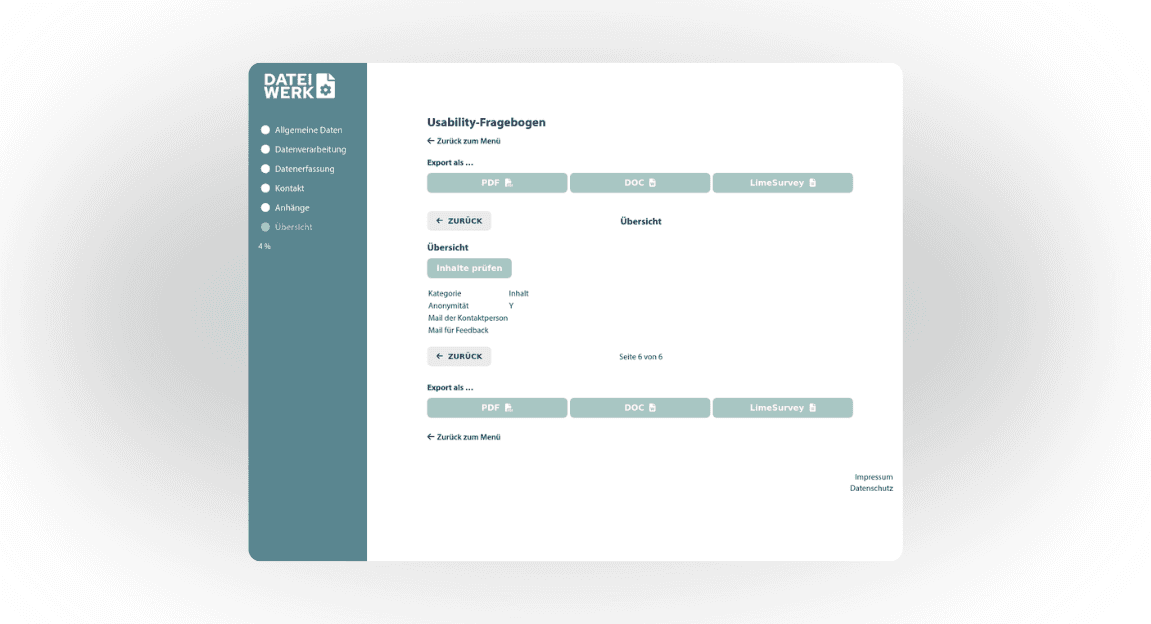

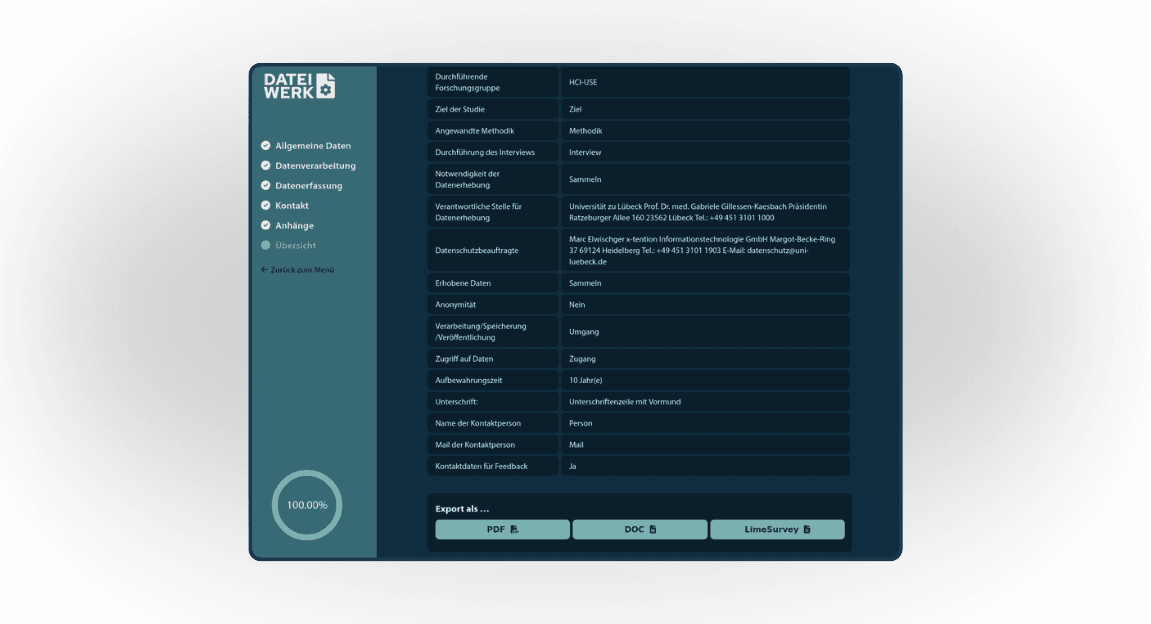

75% Zeitersparnis bei der Dokumentenerstellung. AttrakDiff-Score 4,2, SUS 68,5 – validiert über 5 Evaluationsrunden mit wissenschaftlichen Mitarbeitenden als echten Endnutzenden. Aus einem manuellen Prozess wurde eine funktionsfähige, evaluierte Web-App.

Das Hierarchical Task Inventory deckte auf, wo der echte Aufwand steckte – nicht wo wir ihn vermutet hätten. Diese Analyse war die Grundlage für jede Designentscheidung danach.

Jede Runde – formativ und summativ – brachte neue Erkenntnisse und verhinderte, dass Annahmen ungetestet im Produkt landeten. Nutzerzentriert bedeutet: validieren, nicht raten.

In einem 3er-Team ohne klare Rollen entsteht Chaos. Ich habe früh Verantwortungsbereiche klar abgesteckt und gleichzeitig dafür gesorgt, dass UX Research alle Designentscheidungen informiert.

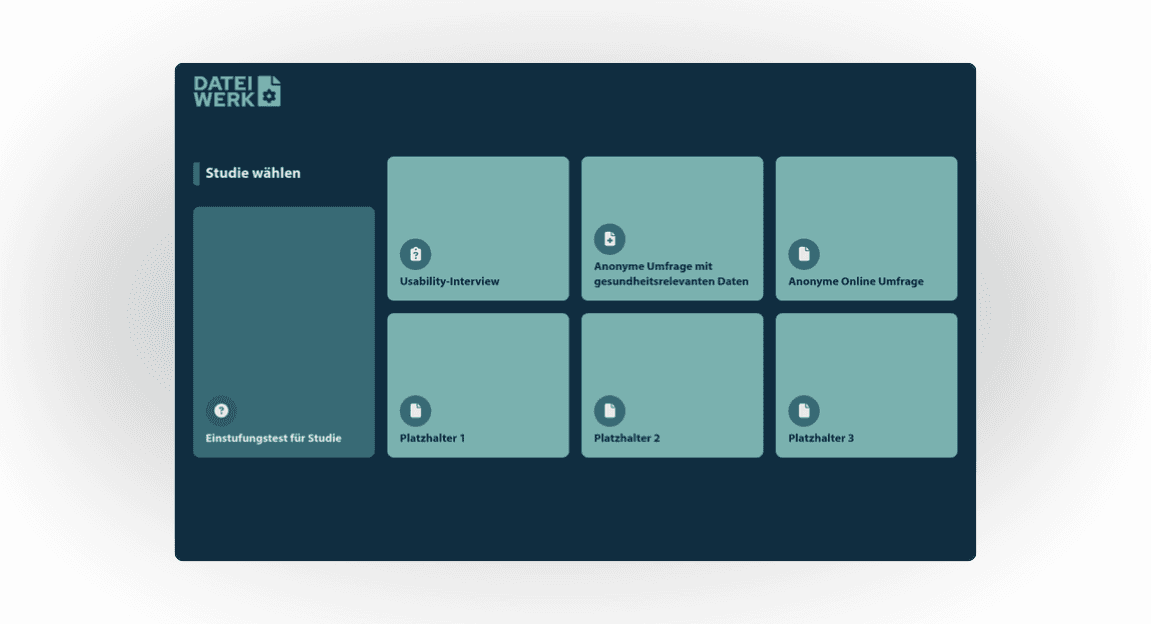

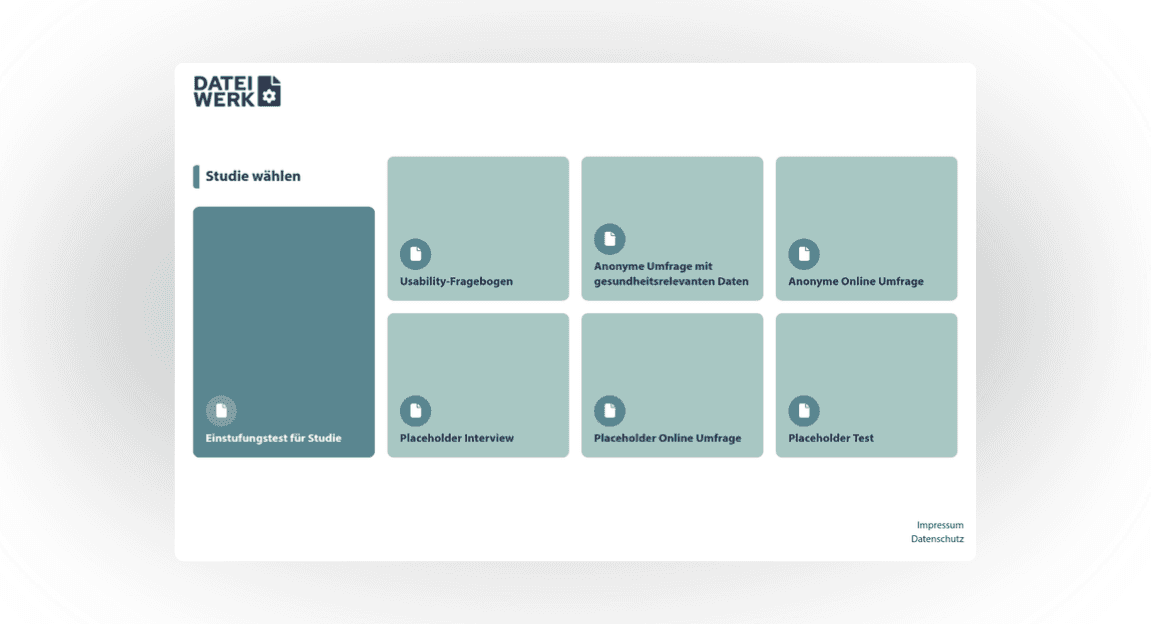

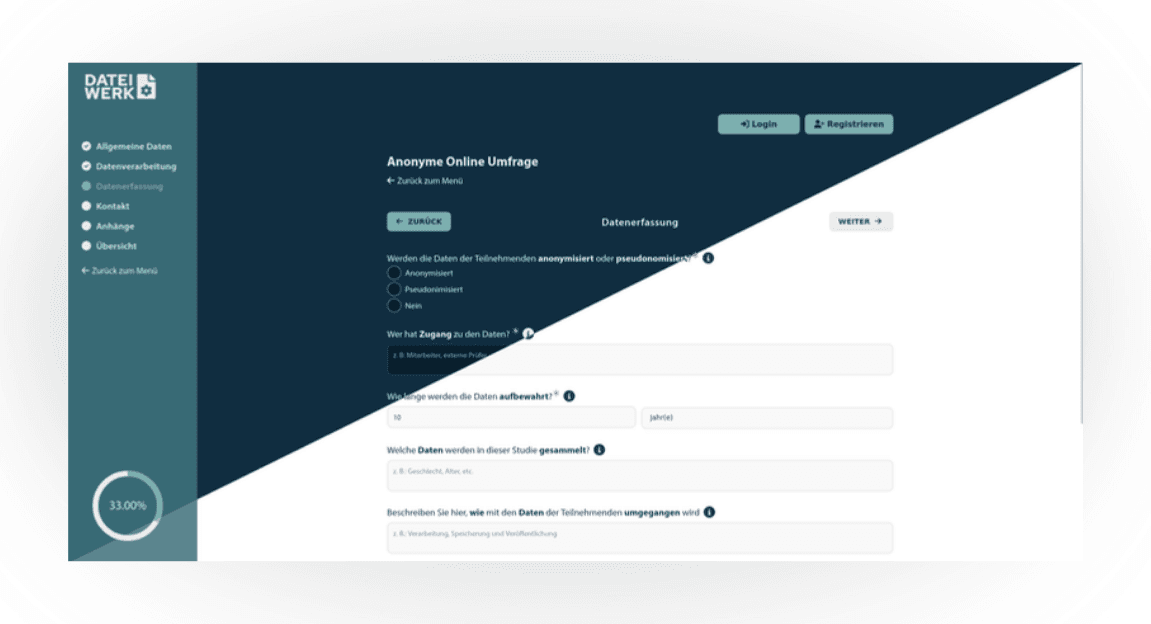

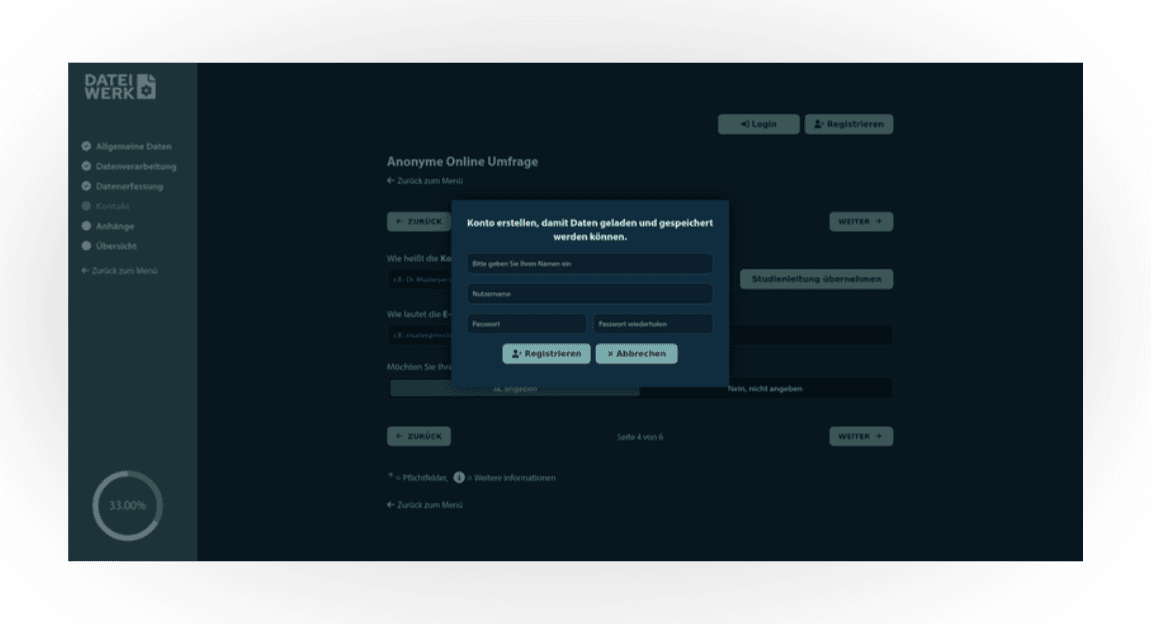

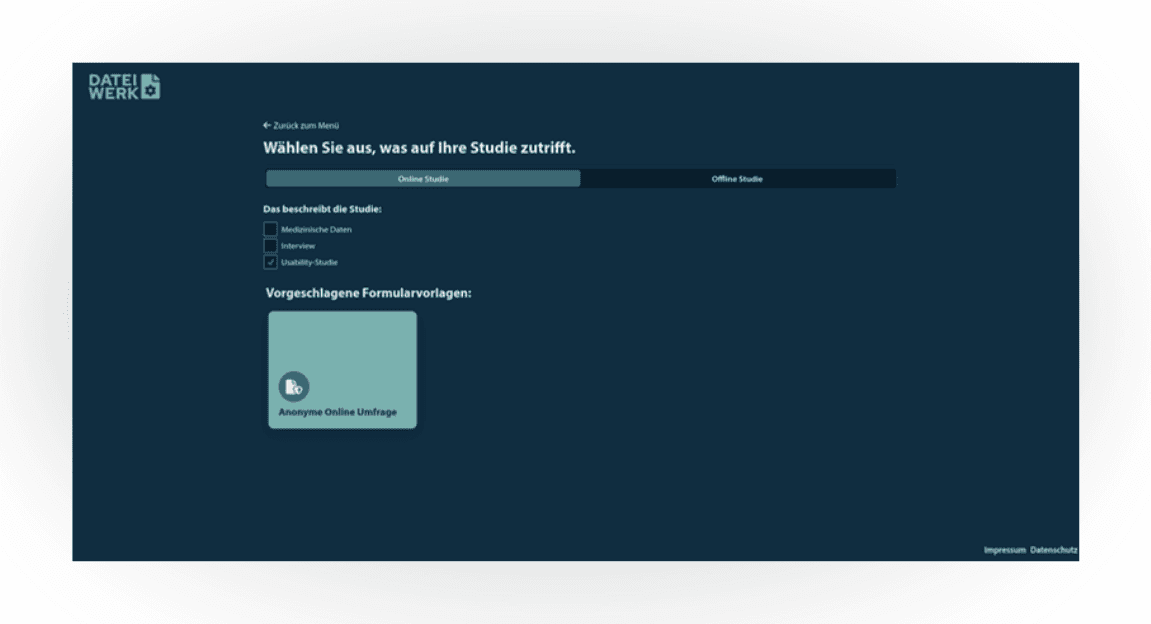

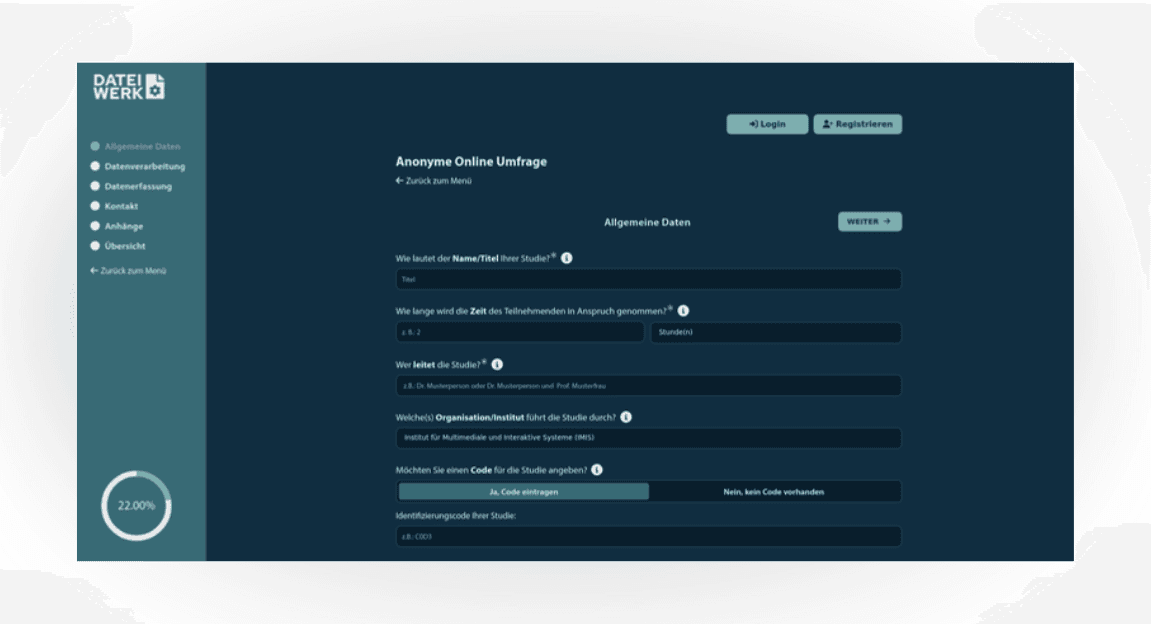

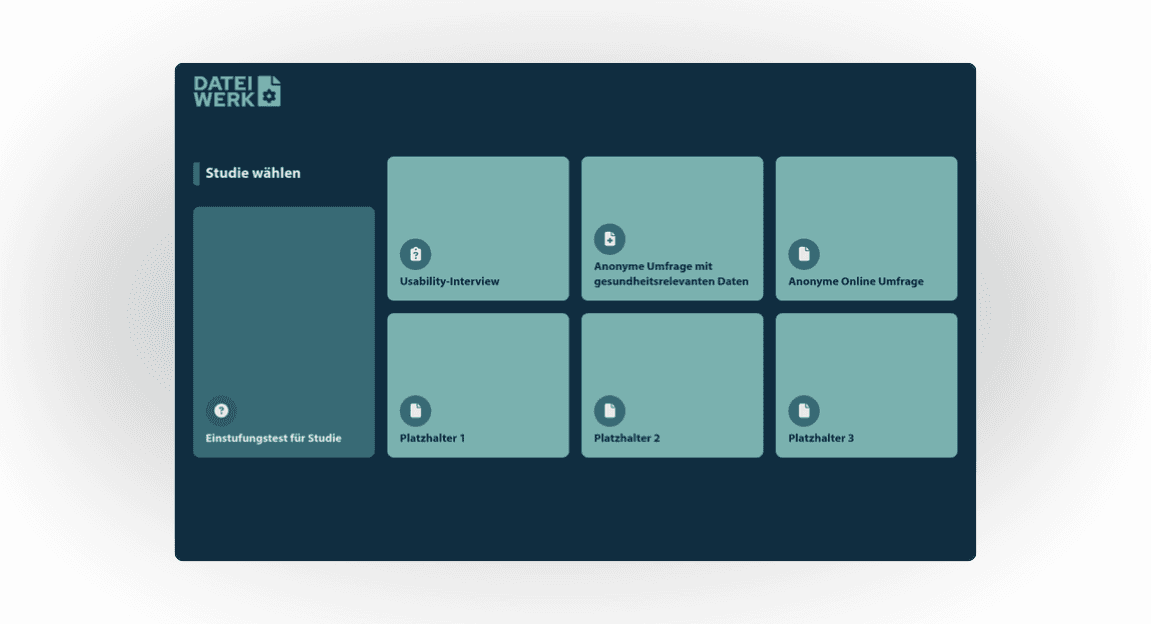

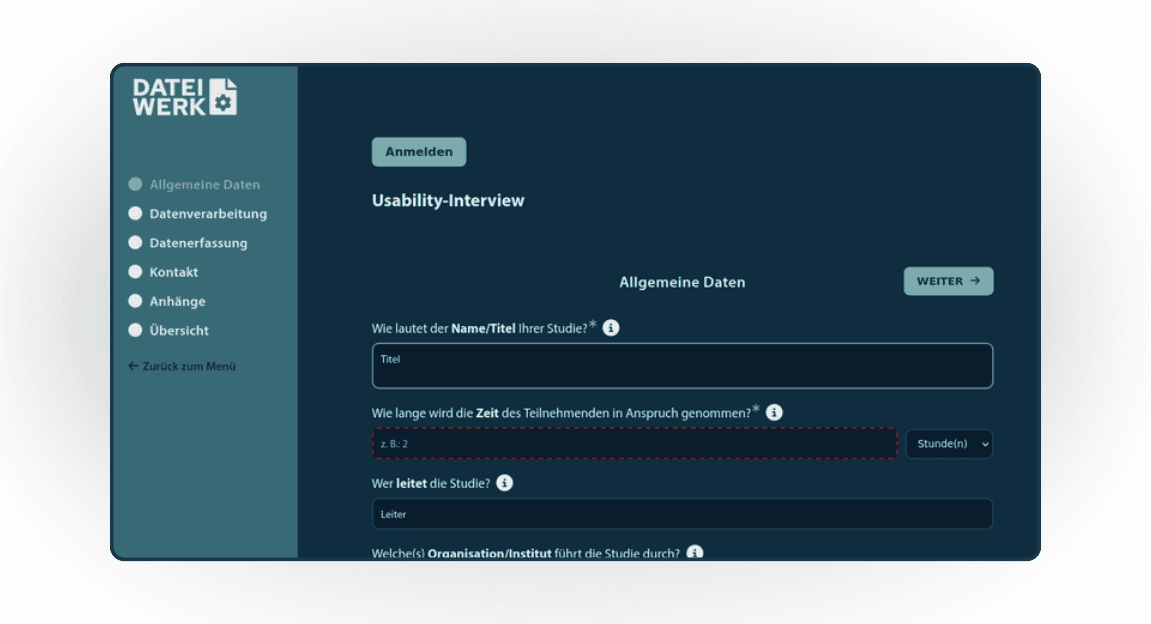

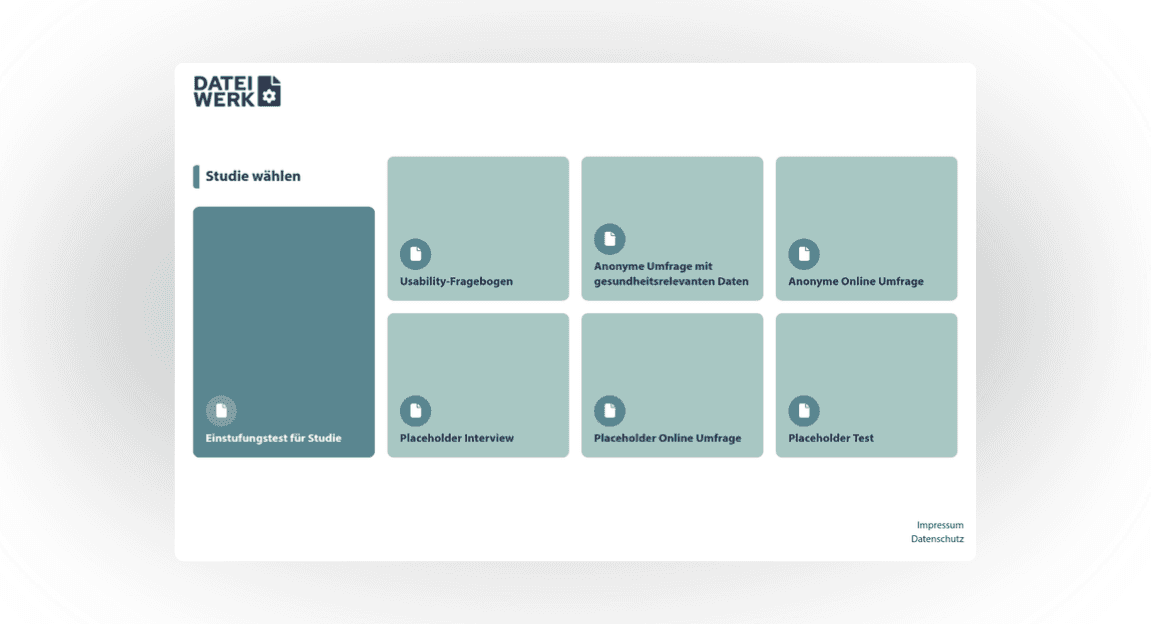

Projektbilder